Deux cartes qui ne jouent pas dans la même cour

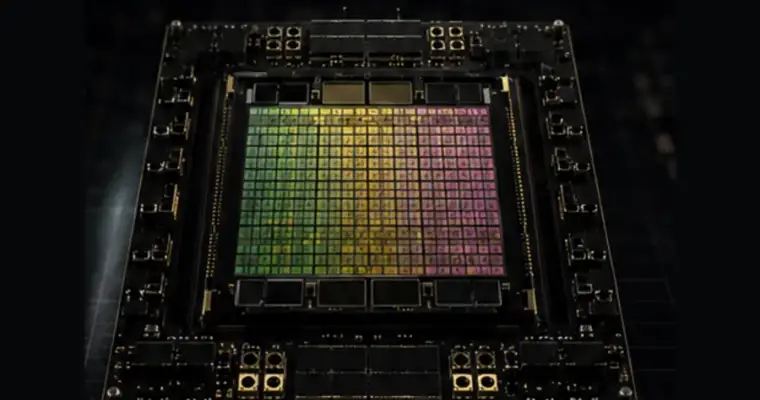

Comparer une RTX 5090 et un H100 a quelque chose de trompeur : ce sont deux réponses à deux questions différentes. La RTX 5090 est une carte grand public, vendue ~2 000 $, conçue pour tenir dans un boîtier de bureau. Le H100 est un module datacenter à plus de 25 000 $, pensé pour le service multi-utilisateurs à grande échelle — ECC, tissu NVLink, refroidissement de rack.

La vraie question n’est donc pas « lequel est le meilleur » — c’est « lequel pour quoi ». Et pour faire tourner un LLM en local, la réponse rationnelle est presque toujours la 5090. Le H100 sert de plafond de référence, pas de décision d’achat.

Ce que la RTX 5090 change vraiment

L’inférence LLM en génération est limitée par la mémoire, pas par le calcul. C’est exactement là que la 5090 progresse.

| Caractéristique | RTX 4090 | RTX 5090 | H100 SXM |

|---|---|---|---|

| VRAM | 24 Go GDDR6X | 32 Go GDDR7 | 80 Go HBM3 |

| Bande passante | ≈ 1,0 To/s | ≈ 1,79 To/s | ≈ 3,35 To/s |

| FP8 (Tensor, pic) | ≈ 660 TFLOPS | ≈ 838 TFLOPS | ≈ 3 958 TFLOPS |

| FP4 | Non | Oui (Tensor 5ᵉ gén.) | Non (Hopper) |

| TDP | 450 W | 575 W | jusqu'à 700 W |

| Prix indicatif | — | ≈ 2 000 $ (achat) | ≈ 25 000 $+ / ~3 $/h |

Le saut le plus utile n’est pas le nombre de cœurs : c’est le passage à la GDDR7 et à ~1,79 To/s de bande passante, contre ~1 To/s sur la 4090. Pour un modèle qui tient en VRAM, ce quasi-doublement se traduit presque directement en tokens par seconde générés. S’ajoutent 8 Go de plus (32 contre 24) et la prise en charge du FP4 par les Tensor Cores de 5ᵉ génération.

Ce qui tient dans 32 Go

La question pratique n’est pas « quelle carte est la plus rapide » mais « quel modèle y tient, et avec quelle marge ».

Concrètement, les 32 Go de la 5090 font tourner confortablement un modèle de classe ~30 milliards de paramètres en quantification de bonne qualité, avec de la marge pour le KV cache et un contexte raisonnable. Un modèle de 70 B n’y tient pas en Q4_K_M : il faut descendre à une quantification agressive (~3 bits ou moins), qui dégrade la qualité de façon visible, ou accepter un déchargement partiel vers la RAM CPU — fonctionnel, mais nettement plus lent. C’est la limite réelle d’une carte grand public, et aucune génération ne la fera disparaître tant que la VRAM reste à 32 Go.

Le H100, et pourquoi tu n’en achèteras pas

Sur le papier, le H100 écrase la 5090 : 80 Go de HBM3 à ~3,35 To/s, un débit FP8 plusieurs fois supérieur, l’ECC, le NVLink. Mais ces avantages sont ceux du datacenter : servir des dizaines de requêtes concurrentes, tenir des contextes longs en batch, s’assembler en nœuds.

Le H100 reste pertinent — mais en location, pour de la production servie à plusieurs. À ~3 $/h chez les fournisseurs cloud, on y accède sans immobiliser 25 000 $. La règle est simple : on loue un H100 pour servir, on achète une 5090 pour développer et faire tourner en local.

Le verdict par usage

| Usage | Choix | Pourquoi |

|---|---|---|

| LLM local, mono-utilisateur | RTX 5090 | 32 Go suffisent pour ~30 B quantifié ; ~2 000 $ |

| Développement / prototypage | RTX 5090 | Itération locale, pas de facture horaire |

| Service multi-utilisateurs | H100 (loué) | Mémoire, batch, NVLink — et pas d'immobilisation |

| Modèles > 30 B en qualité | H100 (loué) | 80 Go évitent la quantification destructrice |

| Confidentialité stricte | RTX 5090 | La donnée ne quitte jamais la machine |

Conclusion

« RTX 5090 vs H100 » n’est pas vraiment un duel : c’est une carte de bureau face à une carte de datacenter. Pour le local, la 5090 est l’outil juste — ses 32 Go de GDDR7 et sa bande passante quasi doublée par rapport à la 4090 en font une vraie machine à LLM personnels, dans la limite des modèles ~30 B. Le H100 reste la référence de production, mais c’est une référence qu’on loue : l’acheter pour un poste, c’est payer dix fois le prix pour un avantage qui ne s’exprime qu’à l’échelle. Avant de trancher, faites le calcul de coût complet.

Sources et méthode

Spécifications RTX 5090 et RTX 4090 : pages produit NVIDIA GeForce et fiches techniques publiques (32 Go GDDR7, ~1,79 To/s, 575 W, MSRP 1 999 $, lancement 30 janvier 2025). Spécifications H100 SXM : page NVIDIA H100 (80 Go HBM3, ~3,35 To/s). Les valeurs FP8 sont des chiffres « pic » constructeurs incluant la sparsité — elles ne reflètent pas un débit soutenu. Les repères de dimensionnement mémoire (Q4_K_M ≈ 4,5 bits/paramètre) sont cohérents avec les tailles observées sur les dépôts GGUF publics ; ils relèvent de l’ordre de grandeur. Prix de location H100 : pages tarifaires des fournisseurs cloud, relevées le 14 mai 2026.