Le débat a changé de nature

Pendant des années, « CUDA vs ROCm » se résumait à une question binaire : est-ce que la pile AMD fonctionne ? La réponse honnête était souvent « pas vraiment, pas sans souffrance ». Ce n’est plus le débat de 2026.

Aujourd’hui, la question est devenue quantitative : quel écart reste-t-il, et où ? C’est un changement important, parce qu’il déplace la décision du registre technique — « est-ce que ça compile » — vers le registre économique — « est-ce que l’écart justifie ou non de quitter l’écosystème NVIDIA ».

L’état des versions

Le rythme de ROCm s’est accéléré, et son périmètre s’est élargi : la pile couvre désormais le datacenter, les Radeon grand public et les puces Ryzen AI, avec des intégrations jusque dans des outils comme ComfyUI. AMD ne traite plus ROCm comme un sous-produit, mais comme un produit à part entière — c’est la condition pour exister face à CUDA.

La parité au niveau framework

Le point décisif : au niveau des frameworks, la parité est essentiellement atteinte. PyTorch, vLLM, SGLang et llama.cpp tournent tous correctement sur ROCm. Un développeur qui écrit du PyTorch standard et sert ses modèles avec vLLM n’a, dans la majorité des cas, pas à savoir sur quel matériel il tourne.

C’est l’effet du travail d’AMD sur la couche d’abstraction, mais c’est surtout l’effet de la communauté : les runtimes majeurs ont intégré ROCm comme cible de première classe parce que leurs utilisateurs le demandaient. La portabilité ne vient pas du compilateur d’AMD seul — elle vient de l’écosystème open source qui a décidé de ne pas dépendre d’un seul fournisseur.

Là où l’écart persiste

La parité framework ne veut pas dire parité totale. Quatre zones d’écart subsistent.

| Zone | État côté ROCm | Contournable ? |

|---|---|---|

| Frameworks (PyTorch, vLLM…) | Parité de fait | Sans objet |

| Performance brute (charges intensives) | ~10–30 % en retrait | Partiellement (kernels) |

| Runtimes propriétaires (TensorRT-LLM, NIM) | Absents — NVIDIA uniquement | Non |

| Kernels de pointe (FlashAttention récent) | Décalage de quelques mois | Oui, avec délai |

| Kernels CUDA sur mesure | À réécrire en HIP | Oui, avec effort |

L’écart de performance brute — de l’ordre de 10 à 30 % sur les charges les plus intensives en calcul — est réel mais variable : il dépend du modèle, de la charge et de la maturité des kernels. Il se réduit à chaque release. Les runtimes propriétaires de NVIDIA (TensorRT-LLM, NIM) restent, eux, structurellement hors de portée — c’est un choix de NVIDIA, pas une limite d’AMD.

Le vrai verrou : l’écosystème, pas le compilateur

C’est précisément ce qui rend la situation intéressante. Un verrou technique se brise avec un bon compilateur ; un verrou d’écosystème se brise avec du temps, des parts de marché et une communauté. AMD a manifestement choisi cette seconde voie — rendre ROCm omniprésent, du portable au datacenter — et le matériel suit : la prochaine génération Instinct (MI450) est attendue au second semestre 2026.

Comment décider

La décision se joue sur trois questions. Votre pile est-elle standard ? Si vous vivez dans PyTorch + vLLM, ROCm est une option crédible, et le matériel AMD haut de gamme est compétitif en mémoire et en débit FP4. Dépendez-vous d’une brique NVIDIA-only ? Si TensorRT-LLM ou NIM sont dans votre chemin critique, la question est tranchée. Quelle est votre tolérance à l’écart de perf ? 10 à 30 % peut être rédhibitoire à très grande échelle, et négligeable pour une charge modérée où la disponibilité et le prix du matériel comptent davantage.

Conclusion

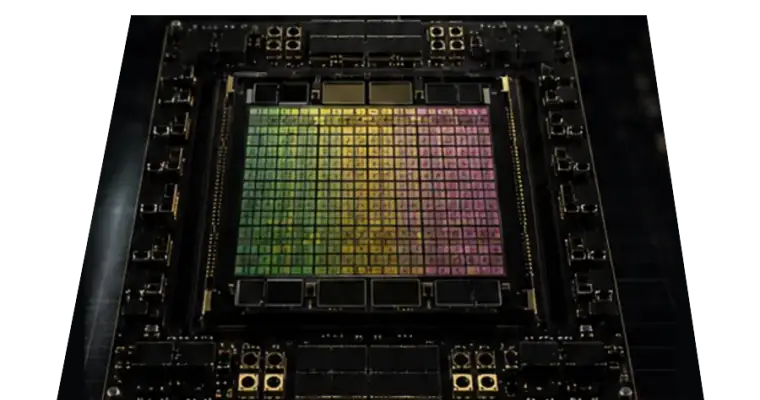

« CUDA vs ROCm » n’est plus une question de faisabilité — c’est une question d’arbitrage. ROCm 7.2 fonctionne, les frameworks majeurs sont à parité, et l’écart restant est un pourcentage de performance plus un écosystème propriétaire, pas un mur. Pour la plupart des équipes sur une pile standard, le choix se fait désormais sur la disponibilité du matériel, le prix et la souveraineté — pas sur le logiciel de base. Pour la comparaison côté silicium, voir MI355X vs B200/B300.

Sources et méthode

Versions : notes de version CUDA Toolkit et notes de version ROCm, consultées le 14 mai 2026. Parité framework et support ROCm de vLLM/SGLang/llama.cpp : documentation publique des projets concernés et de ROCm pour l’IA. L’écart de performance « ~10–30 % » est une estimation crédible synthétisée à partir de comparatifs publics 2025–2026 (Spheron, Thunder Compute) : il dépend fortement de la charge et de la maturité des kernels, et n’a pas valeur de mesure absolue. Calendrier MI450 : communications publiques AMD, 2026.