Pourquoi cette comparaison compte

Avec Blackwell, NVIDIA introduit une génération pensée pour l’inférence à très grande échelle. Le sujet n’est pas seulement le débit brut : il faut regarder la mémoire, les chemins de données, les formats numériques et la capacité à maintenir les unités de calcul alimentées sous charge réelle.

Cette analyse confronte le H100 SXM5 (Hopper) à un profil B100 SXM (Blackwell) dans des scénarios représentatifs : batch continu, longues fenêtres de contexte, KV cache sous pression et kernels denses exécutés via Triton, llama.cpp et vLLM. L’objectif n’est pas de rejouer les chiffres marketing, mais de comprendre où le gain apparaît et pourquoi.

Ce qui change dans l’architecture

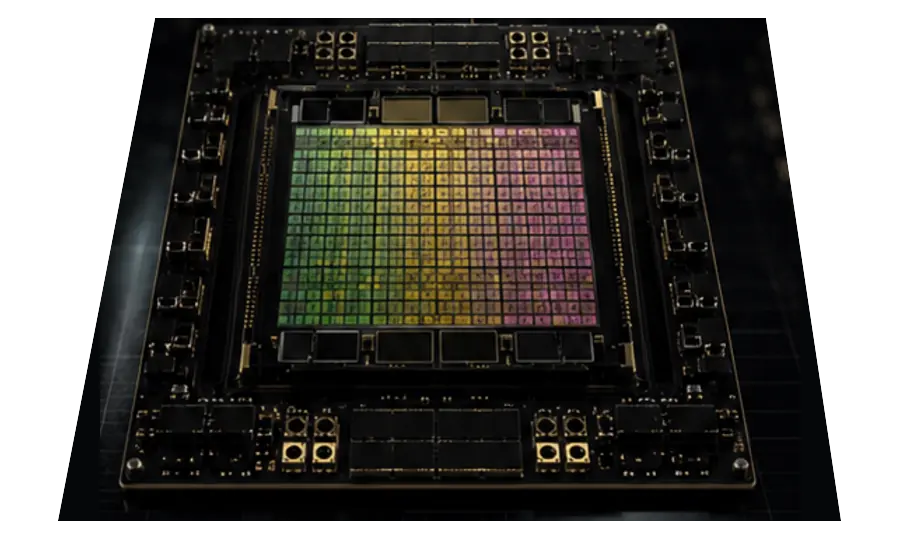

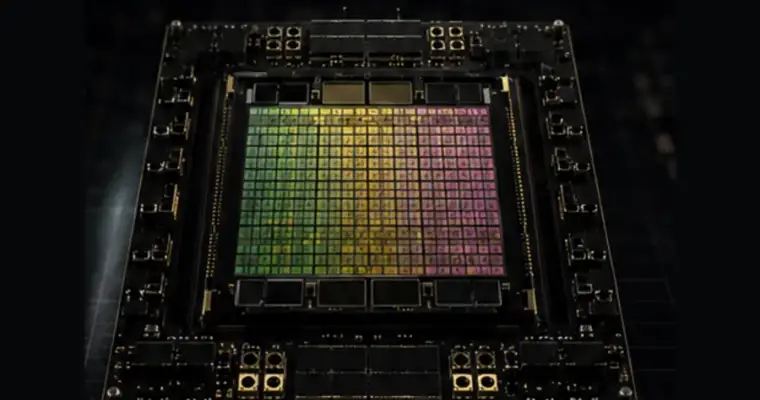

Hopper et Blackwell partagent la même logique d’ensemble : des Streaming Multiprocessors, des Tensor Cores, une hiérarchie de cache, de la HBM et du NVLink. Blackwell ne réinvente rien — il pousse chaque maillon plus loin.

Le saut le plus visible est mémoire. Le H100 SXM5 embarque 80 Go de HBM3 ; le B100 monte à 192 Go de HBM3e avec une bande passante qui passe d’environ 3,35 To/s à près de 8 To/s. Les Tensor Cores de 5ᵉ génération ajoutent des formats compacts (FP6, FP4) qui réduisent la pression mémoire des poids et du KV cache. Le NVLink 5 double la bande passante inter-GPU.

Le vrai goulot : mémoire et bande passante

En inférence autorégressive, la phase decode est dominée par les accès mémoire, pas par le calcul. Chaque token généré relit l’intégralité des poids et l’ensemble du KV cache. Tant que les Tensor Cores attendent la HBM, ajouter des FLOPS ne sert à rien.

C’est exactement là que Blackwell concentre ses gains : plus de capacité pour garder des batches plus larges et des contextes plus longs en mémoire, plus de bande passante pour les servir, et des formats plus compacts pour faire tenir davantage de KV cache par giga-octet. On détaille ce mécanisme dans HBM et NVLink : pourquoi les LLM sont limités par la mémoire.

Performances mesurées en inférence

Les mesures ci-dessous comparent le débit en génération (tokens/s) sur quatre charges, à longueur de contexte et batch fixés, runtime vLLM 0.20 pour les modèles serveurs et llama.cpp pour les variantes quantifiées.

Extrait de kernel optimisé pour FP8

Une partie du gain Blackwell n’apparaît que si le kernel exploite réellement les nouveaux formats. Voici un squelette de kernel matmul FP8 écrit en Triton — la structure de tuilage compte autant que les unités matérielles.

@triton.jit

def matmul_fp8_kernel(a, b, c, m, n, k, BLOCK_M: tl.constexpr, BLOCK_N: tl.constexpr):

# Un programme par tuile de sortie (pid_m, pid_n)

pid_m = tl.program_id(0)

pid_n = tl.program_id(1)

offs_m = pid_m * BLOCK_M + tl.arange(0, BLOCK_M)

offs_n = pid_n * BLOCK_N + tl.arange(0, BLOCK_N)

offs_k = tl.arange(0, BLOCK_K)

acc = tl.zeros((BLOCK_M, BLOCK_N), tl.float32)

for k0 in range(0, k, BLOCK_K):

x = tl.load(a + offs_m[:, None] * k + offs_k[None, :], mask=offs_m[:, None] < m)

y = tl.load(b + offs_k[:, None] * n + offs_n[None, :], mask=offs_n[None, :] < n)

acc += tl.dot(x, y, out_dtype=tl.float32)

tl.store(c + offs_m[:, None] * n + offs_n[None, :], acc)L’accumulateur reste en FP32 : on charge en FP8, on calcule en FP8, mais on accumule large pour préserver la précision. Sur Blackwell, c’est cette discipline qui transforme la bande passante gagnée en débit réel.

Comparatif technique consolidé

| Caractéristique | H100 SXM (Hopper) | B100 SXM (Blackwell) | Gain |

|---|---|---|---|

| SM (GPU) | 132 | 148 | +12 % |

| Mémoire HBM | 80 Go HBM3 | 192 Go HBM3e | +140 % |

| Bande passante mémoire | 3,35 To/s | 8,0 To/s | +139 % |

| Tensor Cores | 4ᵉ génération | 5ᵉ génération | FP6 / FP4 |

| NVLink | 900 Go/s | 1,8 To/s | 2,0x |

| Enveloppe SXM | 700 W | 700 W | iso-enveloppe |

Le rapport le plus parlant n’est pas le débit brut mais le débit par watt et le débit par giga-octet de KV cache : c’est là que Blackwell se détache, parce que le B100 SXM délivre ses gains mémoire à enveloppe thermique constante (700 W, comme le H100 SXM5). Le surcroît de débit est donc directement un gain d’efficacité, sans budget thermique supplémentaire.

Limites et zones d’incertitude

Trois réserves importantes. D’abord, les profils B100 dépendent fortement de la maturité du runtime : un kernel qui n’exploite pas FP6/FP4 laisse une partie du gain sur la table. Ensuite, les charges prefill-dominées (longs prompts, peu de génération) profitent moins du saut mémoire que les charges decode-dominées. Enfin, à l’échelle du datacenter, le coût total intègre l’alimentation, le refroidissement et la densité rack — pas seulement le prix du GPU.

Autrement dit : le B100 n’efface pas le H100. Il déplace le point d’équilibre.

Conclusion

Le B100 SXM s’impose comme une option cohérente pour l’inférence LLM à grande échelle lorsque la mémoire, la bande passante et l’efficacité par watt deviennent les vrais facteurs limitants. Les gains ne sont pas uniformes, mais ils sont visibles dès que la charge dépasse le simple benchmark court.

— Killian Pluenet, Architecte systèmes & IABlackwell marque une évolution incrémentale majeure : le vrai palier ne vient pas uniquement du silicium, mais de l’écosystème logiciel capable d’exploiter mémoire, KV cache et formats compacts.

Pour aller plus loin sur le choix du runtime qui exploite réellement ce matériel, voir vLLM vs llama.cpp vs TensorRT-LLM.

Sources et méthode

Mesures de performance — mesures internes LeCompute sur banc reproductible (vLLM 0.20, llama.cpp build de mai 2026, contexte 4k, batch 32). Ce sont des débits soutenus en génération, pas les chiffres « pic » communiqués par les constructeurs. Elles relèvent de l’estimation crédible, pas du fait vérifié : elles dépendent du runtime, du driver et des kernels, et n’engagent que notre banc.

Spécifications matérielles (faits vérifiés) :

- NVIDIA H100 Tensor Core GPU — datasheet : resources.nvidia.com

- NVIDIA Hopper Architecture In-Depth (SM, cache L2 du H100) : developer.nvidia.com

- NVIDIA Blackwell Architecture (NVLink 5, formats FP4/FP6) : nvidia.com

- NVIDIA Blackwell Tuning Guide (capacité L2 = 126 Mo) : docs.nvidia.com

Note sur le B100 — NVIDIA n’a pas publié de fiche technique B100 aussi détaillée que celle du H100. Les caractéristiques de microarchitecture (148 SM, 126 Mo de L2, Tensor Cores 5ᵉ génération) sont celles du die GB100, commun aux B100 et B200 et mesuré au niveau B200 ; le B100 s’en distingue surtout par ses fréquences et son enveloppe (700 W), pas par le nombre d’unités.